Research

Enterprise AI

AI Strategy

Governance und Risiko richtig aufsetzen

Article by

neuland AI

·

Governance ist kein Bremsklotz – sondern Ermöglicher

Wer generative KI einführt, steht vor einer paradoxen Anforderung: einerseits schnell genug sein, um Wettbewerbsvorteile zu realisieren. Andererseits kontrolliert genug vorgehen, um Risiken nicht zu unterschätzen. Die Lösung liegt nicht in weniger Governance, sondern in besserer.

Ein tragfähiges Governance-Framework für KI beginnt mit einer zentralen Erkenntnis: Generative KI ist keine klassische Software. Sie arbeitet probabilistisch, ihre Ergebnisse sind nicht vollständig reproduzierbar, und die Risiken reichen von Halluzinationen über Datenschutzverletzungen bis zu ethischen Verzerrungen.

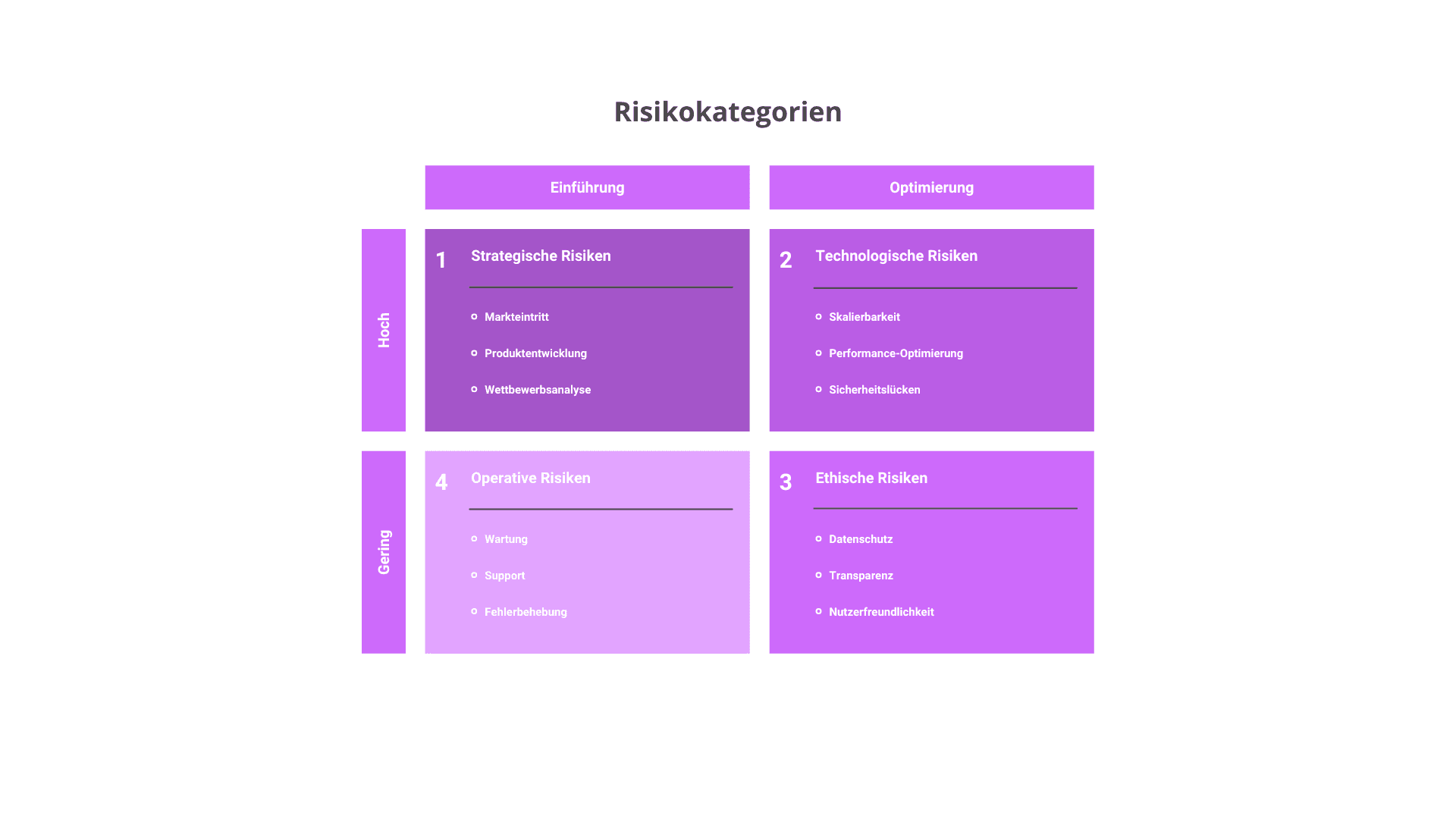

Drei Risikokategorien, die jedes Unternehmen kennen muss

Strategische, finanzielle und regulatorische Risiken betreffen die Abhängigkeit von Drittanbietern, Datenschutzverletzungen und die Einhaltung regulatorischer Vorgaben. Eine verzögerte Integration kann zu Wettbewerbsnachteilen führen, während fehlerhafte Ergebnisse falsche Entscheidungen nach sich ziehen können.

Ethische Risiken beziehen sich auf Bias und Diskriminierung. Generative Systeme können unbewusste Vorurteile verstärken – durch unausgewogene Daten oder Verzerrungen im verwendeten Modell selbst. Transparenz und Verantwortung sind hier zentrale Themen.

Technologische und modellspezifische Risiken umfassen Halluzinationen, fehlende Transparenz, Sicherheitslücken und mangelnde Robustheit. In Multi-Agenten-Systemen potenzieren sich diese Risiken zusätzlich, da einzelne Agenten autonom agieren und unkontrollierte API-Aufrufe oder Datenzugriffe möglich werden.

Der Risikomanagement-Zyklus für KI

Ein wirksames Risikomanagement für KI folgt einem strukturierten Zyklus: Risikoidentifikation nach Festlegung der Ziele und Analyse des GenAI-Inventars. Risikobewertung der identifizierten Risiken hinsichtlich Eintrittswahrscheinlichkeit und Schaden. Risikosteuerung durch gezielte Maßnahmen – von technischen Anpassungen über Sicherheitsmaßnahmen bis hin zu ethischen Überprüfungen. Und schließlich: Implementierung, Überwachung und Verbesserung – denn KI-Risiken sind dynamisch und erfordern kontinuierliche Aufmerksamkeit.

Internes Kontrollsystem: Sieben Kriterien als Leitplanke

Für den Aufbau eines internen Kontrollsystems (IKS) haben sich sieben Kriterien bewährt: der Vorrang menschlichen Handelns und menschlicher Aufsicht, technische Robustheit und Sicherheit, Datenschutz und Governance, Transparenz und Erklärbarkeit, Vielfalt und Nichtdiskriminierung, gesellschaftliches und ökologisches Wohlergehen sowie Rechenschaftspflicht.

Diese Kriterien bilden die Grundlage für konkrete Kontrollen: von der menschlichen Überprüfung generierter Outputs über Mechanismen zur Bias-Erkennung bis hin zu klaren Eskalationspfaden bei unerwünschtem Systemverhalten.

Fazit

Governance für generative KI ist keine einmalige Einrichtung, sondern ein lebendiger Prozess. Wer früh die richtigen Strukturen schafft, kann schneller skalieren – weil das Vertrauen in die Technologie fundiert ist. Im nächsten Teil geht es darum, wie Anwendungsfälle systematisch identifiziert, bewertet und priorisiert werden.